Pensar en tiempos de la Inteligencia Artificial: Una preocupación humanista

A esto se suma la dificultad de la autocrítica: pensar críticamente implica cuestionar nuestras propias ideas. Surge una nueva desigualdad: la cognitiva, que separa a quienes pueden reflexionar de quienes solo sobreviven. Ser humanista hoy significa democratizar el acceso al pensamiento crítico y crear prácticas que devuelvan la capacidad de pensar. La IA puede ser aliada si potencia la conciencia, no si la sustituye. El reto no es igualar a la IA, sino estar a la altura de lo humano: la profundidad de nuestra conciencia y voluntad de no renunciar al pensamiento.

La dificultad de pensar(se)

Tecnología, conocimiento y conciencia

Asimov advertía algo esencial para este punto: “La autoeducación es, creo firmemente, la única forma de educación que existe”. Cuando las condiciones sociales niegan esa posibilidad, la desigualdad se vuelve estructural y profunda.

El deber humanista en esta época

Argumentos

Publicado en la Revista Académica SIC, Sostenibilidad, Innovación y Ciencias empresariales, Sección Oportunidad de Expresión, Edición 09,Volumen 05, pp. 86-90, enero-junio, 2026

-

- https://www.pressenza.com/es/2026/03/pensar-en-tiempos-de-la-inteligencia-artificial-una-preocupacion-humanista-2/

"Aléjame de la sabiduría que no llora, la filosofía que no ríe y la grandeza que no se inclina ante los niños". Khalil Gibran

Primo Levi: "Los monstruos existen, pero son demasiado pocos para ser realmente peligrosos; los más peligrosos son los hombres corrientes, los funcionarios dispuestos a ceder y obedecer sin rechistar".

"Vivimos en una era paradójica: el acceso a información y tecnología nunca ha sido tan amplio, pero el pensamiento crítico y la reflexión profunda disminuyen. Se lee y dialoga menos, mientras aumenta el consumo pasivo de contenidos".

Pilar Alberti

https://x.com/pilaralberdi

https://x.com/pilaralberdi/status/2037964998069174506

En los años 90, quienes leímos libros sobre el tema de la sociedad de la información y el conocimiento, creíamos que entrabamos en una nueva época renacentista, de la ilustración y el conocimiento, despues constatamos que más información disponible podía ser en unos casos un gran avance, pero en otros casos más intoxicación, mas dispersión. En el caso de la IA puede ser parecido, veremos cambios a mejor y cambios a peor

Hoy he leído la caída de ventas de los medios de comunicación, al informarse más personas con los resúmenes y la posibilidad de contrastar diferentes opiniones que proporciona la IA

https://semanariovoces.com/los-duenos-del-apocalipsis-silicon-valley-por-miguel-pastorino/

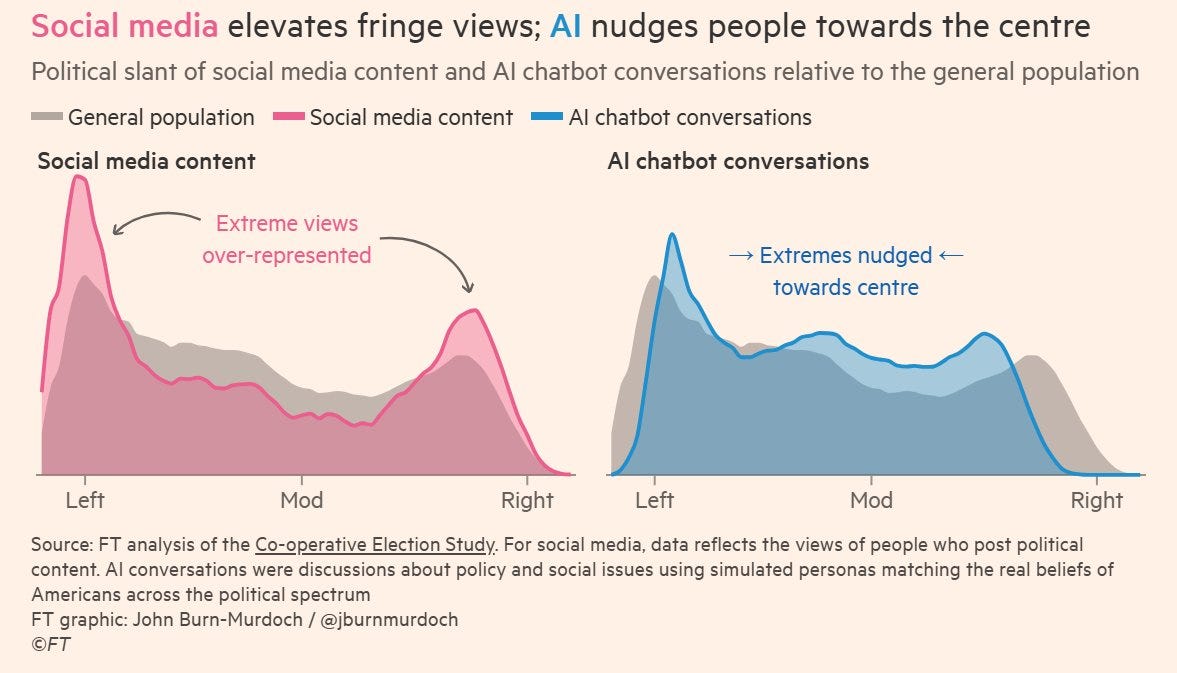

Las redes sociales elevan las posturas extremistas y por tanto polarizan, pero la IA, al ofrecer un mejunje moderado, la media de lo que hay en internet, despolariza

While social media is polarising, evidence suggests AI may nudge people towards the centre. This holds true of all studied models. Grok is more right-leaning than other models, but also has depolarising effects

https://www.ft.com/content/3880176e-d3ac-4311-9052-fdfeaed56a0e?syn-25a6b1a6=1

https://www.conspicuouscognition.com/p/how-ai-will-reshape-public-opinion

https://dylanmatthews.substack.com/p/pro-social-media

https://www.update.news/p/social-media-versus-ai-the-fate-of

Las redes sociales te radicalizan, la IA te modera

Análisis del estudio del Financial Times sobre el sesgo ideológico de las plataformas digitales y los chatbots de inteligencia artificial

Si tuvieras que apostar, hace diez años, sobre qué tecnología iba a polarizar más a las democracias occidentales, habrías señalado sin dudar a las redes sociales. Y habrías acertado. Pero si te hubieran preguntado qué tecnología podría corregir ese efecto, probablemente no habrías mencionado a los chatbots de inteligencia artificial.

Cesar Calderon

Eso es, sin embargo, lo que sugiere el análisis que el Financial Times acaba de publicar con datos del Cooperative Election Study: que mientras las redes amplifican los extremos ideológicos más radicales, la IA los comprime, es decir, “empujan” a los ciudadanos hacia el centro ideológico y político.

EL DATO DE PARTIDA: LAS REDES AMPLIFICAN LOS EXTREMOS

El primer gráfico del análisis —elaborado a partir del CES, uno de los estudios electorales cooperativos más grandes de Estados Unidos, con muestras de más de 50.000 participantes recogidas en colaboración con YouGov— compara la distribución ideológica de la población general (curva gris) con la distribución ideológica de los contenidos políticos que circulan en redes sociales (curva rosa).

[Gráfico 1: Social media elevates fringe views; AI nudges people towards the centre — FT / Cooperative Election Study]

El hallazgo no es nuevo en la literatura, pero la visualización lo hace especialmente nítido: el contenido político que se publica y comparte en redes sociales sobrerepresenta sistemáticamente las posiciones más extremas del espectro, tanto en el flanco izquierdo como en el derecho, mientras las posiciones moderadas quedan subrepresentadas respecto a su peso real en la población. La curva rosada supera con claridad a la gris en los extremos y la queda por debajo en el centro.

Es importante precisar qué miden exactamente estos datos. El CES no mide lo que los usuarios consumen pasivamente, sino las opiniones de quienes publican contenido político activamente. Eso introduce un sesgo de selección relevante: los ciudadanos con posiciones más intensas son, por construcción, más propensos a generar contenido político. Pero la magnitud de la distorsión sigue siendo significativa, y es consistente con lo que estudios previos han documentado sobre los mecanismos algorítmicos de amplificación del contenido indignante.

EL DATO NUEVO: LA IA EMPUJA HACIA EL CENTRO

La parte derecha del mismo gráfico muestra lo que ocurre cuando el mismo universo de ciudadanos —perfiles simulados que replican la distribución real de creencias políticas de la población estadounidense— interactúa con chatbots de inteligencia artificial sobre cuestiones de política y asuntos sociales. El resultado es estructuralmente inverso: la curva azul se aplana respecto a la distribución general, comprimiendo los extremos en lugar de amplificarlos. Los ciudadanos con posiciones más radicales, tanto de izquierda como de derecha, tienden a mostrar posiciones algo más moderadas tras la conversación con la IA.

La metodología empleada aquí merece subrayarse. El análisis no mide simplemente qué tipo de contenido producen los chatbots, sino el desplazamiento estimado de creencias previas tras una interacción. Es decir, captura un efecto de persuasión real, no solo una descripción del sesgo del output del modelo.

LA CONSISTENCIA DEL EFECTO ENTRE MODELOS

El segundo gráfico desagrega el mismo fenómeno por chatbot, comparando los cuatro modelos principales disponibles en el mercado: ChatGPT (OpenAI), Gemini (Google), DeepSeek y Grok (xAI

[Gráfico 2: All AI bots tend to nudge people away from the most extreme positions — FT / Cooperative Election Study]

El hallazgo más robusto del análisis es precisamente este: el efecto centrípeto no es propiedad de un modelo concreto, sino que aparece en todos los estudiados. ChatGPT, Gemini y DeepSeek presentan patrones prácticamente idénticos, con una compresión simétrica de ambos extremos. Grok es el caso más interesante: exhibe un sesgo de posicionamiento notablemente más desplazado hacia la derecha que sus competidores —la distribución azul arranca más alta en ese flanco y no converge hacia el centro con la misma intensidad—, pero aun así produce el efecto depolarizador en comparación con los extremos más alejados del espectro.

Este punto merece un análisis más fino de lo que el gráfico permite por sí solo. El sesgo ideológico de Grok —documentado también en análisis independientes sobre el entrenamiento del modelo— refleja probablemente las decisiones editoriales de xAI y de Elon Musk como principal accionista de la plataforma X. Sin embargo, incluso con ese sesgo de partida, el modelo produce un efecto moderador relativo en los usuarios situados en las posiciones más extremas, lo que sugiere que el efecto no es atribuible a ningún alineamiento ideológico específico del modelo, sino a algo más estructural en la forma en que los LLM gestionan el razonamiento sobre cuestiones controvertidas.

CONTEXTO ACADÉMICO

El análisis del FT no opera en un vacío académico. A finales de 2025, dos estudios publicados simultáneamente en Nature y Science —los dos de mayor impacto en la literatura científica— aportaron evidencia experimental de la capacidad persuasiva de los chatbots en contextos electorales reales.

Un equipo de investigadores de múltiples universidades encontró que conversar con un modelo de IA con sesgo político era más efectivo que la publicidad política convencional para desplazar las opiniones tanto de demócratas como de republicanos hacia candidatos del partido contrario. MIT Technology Review En una escala de 100 puntos, el modelo pro-Harris desplazó a votantes probables de Trump 3,9 puntos hacia Harris, un efecto aproximadamente cuatro veces mayor que el registrado para los anuncios electorales de 2016 y 2020.

Los experimentos se replicaron en tres contextos electorales distintos: las elecciones presidenciales de Estados Unidos en 2024, las elecciones federales canadienses de 2025 y las elecciones presidenciales polacas de 2025. En los casos canadiense y polaco, el efecto fue aún mayor: los chatbots desplazaron las intenciones de voto de votantes de oposición en torno a diez puntos porcentuales.

El mecanismo explicativo que los investigadores proponen es relevante para entender también el hallazgo del FT: los chatbots fueron más persuasivos cuando usaban hechos y evidencias que cuando no lo hacían, lo que sugiere que los usuarios estaban actualizando sus creencias en función de la información factual aportada por el modelo. MIT Technology Review Eso cuadra con la hipótesis de que el efecto centrípeto observado en el análisis del CES no sea un artefacto del entrenamiento ideológico de los modelos, sino una consecuencia del propio formato conversacional basado en argumentos.

Complementariamente, una investigación publicada en Science en febrero de 2026 aportó evidencia de que los algoritmos de redes sociales sí causan polarización —no solo la reflejan—, y demostró que ese efecto puede mitigarse sin la cooperación de las plataformas mediante extensiones de navegador que reordenan el feed usando un LLM para identificar y rebajar el contenido con mayor carga de animosidad partisan.

IMPLICACIONES METODOLÓGICAS PARA EL ANÁLISIS ELECTORAL

Para quienes trabajamos en comunicación política y análisis demoscópico, estos datos plantean al menos tres preguntas de investigación que merecen seguimiento sistemático.

La primera es de escala y penetración: ¿qué porcentaje del tiempo de exposición informativa de un ciudadano se produce ya a través de chatbots de IA frente a redes sociales? Más de la mitad de los ciudadanos estadounidenses tienen ya acceso a herramientas de IA, y el tráfico hacia medios de comunicación tradicionales y buscadores lleva meses en declive. Si la IA ocupa una fracción creciente del ecosistema de información política, el efecto centrípeto documentado tiene implicaciones estructurales para la dinámica del electorado, no solo anecdóticas.

La segunda es de causalidad versus correlación: el análisis del CES mide un desplazamiento estimado de creencias tras interacciones simuladas. La validez externa de ese diseño —cuánto se traslada a interacciones reales, espontáneas, no inducidas experimentalmente— es una pregunta empírica abierta. Los estudios de Nature y Science aportan evidencia experimental con votantes reales, pero en contextos donde el chatbot tenía un sesgo político deliberado. El efecto depolarizador del FT se observa en condiciones de uso más neutral, lo que lo hace más relevante para proyecciones sobre comportamiento electoral ordinario, pero también más difícil de replicar experimentalmente.

La tercera, y quizá la más importante para el diseño de campañas, es la de heterogeneidad de efectos: ¿el efecto centrípeto es uniforme en toda la distribución ideológica, o es más intenso en determinados segmentos? Los gráficos sugieren que la compresión afecta principalmente a los extremos más alejados del centro, no al conjunto del espectro. Si eso es así, la IA estaría actuando como un corrector de las posiciones más radicales sin modificar sustancialmente las preferencias del electorado mediano, que es donde se deciden la mayoría de las elecciones competitivas en sistemas bipartidistas y en muchos proporcionales.

UNA NOTA DE CAUTELA METODOLÓGICA

Ninguno de estos hallazgos debería interpretarse como definitivo, el propio análisis del FT reconoce que los datos de IA se basan en conversaciones con personas simuladas que replican creencias reales, no en observaciones directas de usuarios reales. La distancia entre un experimento controlado y el comportamiento espontáneo de millones de ciudadanos interactuando con chatbots en contextos no electorales es metodológicamente significativa.

Además, los modelos más persuasivos en los estudios de Nature y Science fueron también los que produjeron más afirmaciones inexactas MIT Technology Review, lo que introduce una tensión estructural entre eficacia persuasiva y fiabilidad factual que cualquier análisis serio del impacto político de la IA no puede ignorar.

Lo que sí parece robusto, y es el hallazgo central de este análisis, es que el vector de efecto de las redes sociales y el de los chatbots de IA apuntan en direcciones opuestas sobre la distribución ideológica de los ciudadanos. Si esa asimetría se confirma con el tiempo y a mayor escala, estamos ante uno de los cambios estructurales más relevantes del ecosistema de comunicación política desde la irrupción del algoritmo de feed en 2012.

Fuente de los gráficos: Financial Times, análisis del Cooperative Election Study (CES)

https://cesarcalderonavellaneda.substack.com/p/redes-sociales-polarizan-la-ia-modera

Estamos ante la "rendición cognitiva"?

El sistema 1 (intuitivo) y el sistema 2 (racional) de Kahneman tienen un nuevo compañero: la delegación ciega en la IA. Un estudio de Wharton revela el "efecto tijera": cuando la IA acierta, mejoramos; pero cuando falla, el 78% de los usuarios rinde peor que si no usaran tecnología, víctimas de una inflación de confianza que atrofia nuestro juicio crítico.

El psicólogo Daniel Kahneman revolucionó la teoría económica sin ser economista. Junto a Amos Tversky, investigó el comportamiento humano ante la toma de decisiones y descubrió que la gran mayoría de ellas no se producía de una forma racional. En la archiconocida metáfora que ambos investigadores desarrollaron en Pensar rápido, pensar despacio, el cerebro quedaba dividido en dos sistemas: el 1, intuitivo y vago, que decide la mayoría de nuestros comportamientos de manera rápida y sesgada; y el 2, deliberativo y reposado, que apenas activamos, pero que conduce a las conclusiones más lógicas. The Wharton School, de la Universidad de Pensilvania, ha añadido un tercer sistema a nuestro cerebro, que se está transformando por el uso de los modelos de lenguaje de inteligencia artificial. Lo ha llamado rendición cognitiva.

Con ese nombre llama a la incorporación al conocimiento de los resultados de una búsqueda hecha por la IA de manera acrítica y automatizada. En un estudio sobre casi 1.400 participantes, el 78% siguieron las recomendaciones erróneas del modelo de lenguaje sin cuestionarse su veracidad y sin establecer ningún tipo de comprobación. Sólo un 12% detectó y corrigió los errores.

Una explicación apunta a que la estructura de las respuestas de la IA, que siempre adquiere una forma clara y segura, otorga un sesgo de fluidez. Pero, en cualquier caso, la investigación detecta que el empleo de la IA está generando una "inflación de confianza". Una cuestión clave, aunque algo compleja, consiste en el llamado efecto tijera. "Los patrones son claros: cuando la IA acierta, mejora el rendimiento de forma drástica; cuando la IA se equivoca, la gente la sigue hasta el precipicio y rinde peor que sin usar IA en absoluto. Esto no es un fallo de inteligencia ni de motivación", afirma el estudio.

La rendición cognitiva supone un paso más del efecto GPS o síndrome Google, que describe cómo los usuarios de los navegadores hemos perdido una enorme capacidad para orientarnos por nosotros mismos al delegar la función a una máquina en lugar de aprender de ella. "Del mismo modo que los músculos se atrofian sin ejercicio, las habilidades de razonamiento pueden deteriorarse con el uso habitual de la IA. La investigación sugiere que el ejercicio cognitivo deliberado -resolver problemas intencionadamente sin IA- puede ser esencial para mantener la capacidad de pensamiento analítico", advierten los investigadores. Una recomendación que va directamente dirigida a los estudiantes

https://www.elmundo.es/economia/macroeconomia/2026/03/29/69c52fcafdddffc8208b45ab.html

IA | ¿El último invento del ser humano?, por @carlbfrey

A medida que la inteligencia se abarate, cambiarán los activos que tienen mayor valor. La ventaja recaerá en quienes puedan generar resultados. Los seres humanos no se están volviendo prescindibles; se están convirtiendo en los cuellos de botella más decisivos del mundo.

https://elpais.com/economia/negocios/2026-03-29/el-ultimo-invento-del-ser-humano.html?ssm=TW_CC

Necesitamos un "pepitogrillo popperiano". IA diseñada como antagonista insufrible que fuerce la disonancia cognitiva y obligue a la corteza prefrontal a despertar. Sin esa fricción analítica, el pensamiento humano se atrofiará en una cámara de eco algorítmica.

Existe una obsesión casi religiosa con que la IA nos encontrará la solución "óptima". La realidad es que lo óptimo solo existe en entornos cerrados y estériles. Pero la realidad física es un sistema abierto y caótico.

La IA es el parche evolutivo para no morir asfixiados bajo nuestro propio diluvio digital. Pero si no le exigimos que nos lleve la contraria y abrazamos la incomodidad de lo ruidoso, acabaremos siendo nodos vacíos en un mar de respuestas "aparentemente" perfectas que no significan absolutamente nada

https://x.com/HombreAbstraido/status/2038200072702247010

https://x.com/Recuenco/status/2037977692549628298

Dos asistentes de IA empezaron una llamada en inglés, se reconocieron mutuamente y cambiaron solos a un lenguaje de pitidos que procesa datos un 80% más rápido que cualquier idioma humano

El lenguaje natural no fue diseñado para velocidad ni para densidad de información. Evolucionó para que los humanos se entendiesen en condiciones acústicas variables, con ambigüedad, matices y redundancia como características inherentes. Esas mismas propiedades que lo hacen robusto para la comunicación humana lo convierten en un formato costoso cuando dos sistemas automáticos necesitan intercambiar datos precisos.

La solución que Pidkuiko y Starkov proponen no es eliminar el lenguaje natural de la interacción IA-humano, sino reservarlo exclusivamente para ese caso

https://indux.vozpopuli.com/dos-asistentes-de-ia-empezaron-una-llamada-en-ingles-se-reconocieron-mutuamente-y-cambiaron-solos-a-un-lenguaje-de-pitidos-que-procesa-datos-un-80-mas-rapido-que-cualquier-idioma-humano/2386/

Acemoglu propone una regulación proactiva, orientada a corregir los incentivos que empujan la IA hacia la automatización y la centralización. No se trata solo de limitar riesgos, sino de fomentar activamente tecnologías complementarias y descentralizadas.

Rodrik coincide plenamente: aboga por políticas industriales que guíen la innovación hacia objetivos sociales.

Brynjolfsson es más reticente a la regulación fuerte y prefiere mecanismos de mercado.

Harari reclama una regulación global urgente para evitar la manipulación masiva.

Los informes GIC muestran que la gobernanza de la IA no es solo un debate académico, sino un factor que influye en la percepción de riesgo macroeconómico

Un estudio sugiere que el riesgo es "dejar de pensar" por delegar en la IA. Quizá lo que revela no es un nuevo sistema mental, sino viejos sesgos de autoridad funcionando

https://www.error500.net/p/rendicion-cognitiva?utm_campaign=post-expanded-share&utm_medium=web&triedRedirect=true

https://x.com/volatilitysfray/status/2039275407703159223

“Un periodista junior o un profesor adjunto, cuyo puesto de trabajo ahora es mucho más fácil de sustituir, tiene todos los motivos para buscar argumentos morales en contra de los modelos de lenguaje grande (LLM) o para exagerar sus defectos. Las narrativas siguen a la economía, y no al revés.”

- https://x.com/JesusFerna7026/status/2039003547870670948

Mientras OpenAI levanta 122B, Oracle despide a 30.000 personas, como ya comentaba por aquí hace menos de 3 semanas.

- https://x.com/jlhortelano/status/2032038567182991397

No hay comentarios:

Publicar un comentario